Vol. 21, núm. 1 enero-febrero 2020

Chateando con Mitsuku

Ana Lidia Franzoni Velázquez CitaResumen

Los agentes de conversación y los sistemas de diálogo (interfaces de control de voz, chatbots, asistentes personales) están ganando impulso como técnicas de interacción humano-computadora en la sociedad digital. Al platicar con Mitsuku (una inteligencia artificial conversacional) te puedes dar cuenta que es capaz de seguir una conversación, de recordar datos e, incluso, de aceptar correcciones. Aunque todavía hay que esperar un poco más para que sea verdaderamente conversacional, los asistentes virtuales no están hechos aún para pláticas reales, nos debemos preparar porque se encuentran en plena expansión y están dando el salto a servicios de la vida diaria.

Palabras clave: chatbot, inteligencia artificial conversacional, Mitsuku.Chatting with Mitsuku

Abstract

Conversation agents and dialogue systems (voice control interfaces, chatbots, personal assistants), are gaining momentum as human-computer interaction techniques in the digital society. When you talk with Mitsuku (a conversational artificial intelligence), you can realize that it is able to follow a logical conversation, accept corrections, and remember data and information. But we still have to wait a little longer to be truly conversational. Virtual assistants are not made for real conversations yet. We must be prepared because they are in full expansion and are making the leap to daily life services.

Keywords: chatbot, conversational artificial intelligence, Mitsuku.Introducción

Los agentes de conversación y los sistemas de diálogo (interfaces de control de voz, chatbots, asistentes personales, asistentes virtuales) están desarrollándose como técnicas de interacción humano-computadora en la sociedad digital. Por ahora, podemos encontrar una gran cantidad de interacción lingüística con agentes inteligentes (comunicación mediada por computadora) en internet, desde sistemas de reserva de aerolíneas, aplicaciones para consultar el clima, para los bancos o para las conversaciones instantáneas (Messenger, WhatsApp), hasta en catálogos de mercancías. Si bien la idea de utilizar el lenguaje humano para comunicarse con las computadoras se basa en la inteligencia artificial, los científicos tienen un reto con la complejidad de este lenguaje, tanto en el entendimiento como en su generación. El obstáculo para las computadoras no reside sólo en entender los significados de las palabras, sino interpretar la infinita variedad de cómo se emplean para comunicar un significado en específico. La palabra chatbot suena a mensaje automatizado, a robot, a inteligencia artificial. Ciertamente, éstos son “sistemas de conversación de máquinas que interactúan con usuarios humanos a través de una conversación en lenguaje natural” (Shawar y Atwell, 2005). En otras palabras, se trata de un programa de computadora que imita una plática con lenguaje natural. Por lo tanto, para dar respuestas adecuadas a palabras clave o frases extraídas de un discurso y mantener una conversación continua es necesario construir un sistema de diálogo (programa) llamado chatbot (Abdul-Kader y Woods, 2015). Un chatbot se puede dividir en tres principales componentes: contestador, clasificador y graphmaster, que se describen a continuación (ver figura 1).

Figura 1. Componentes de un chatbot. Fuente: elaboración propia con base en Stoner, Ford y Ricci (2003).

1) Contestador. Interfaz entre las rutinas principales del bot-software preparado para realizar tareas repetitivas a través de internet simulando el comportamiento de un humano– y el usuario. Transfiere y controla la entrada y la salida de datos del usuario al clasificador. 2) Clasificador. Segmenta la entrada ingresada por el usuario en componentes lógicos y transfiere la oración normalizada al graphmaster; asimismo, procesa su salida y maneja las instrucciones de la sintaxis de la base de datos. 3) Graphmaster. Organiza y maneja el proceso de coincidencia de patrones que implican búsquedas avanzadas. Las técnicas de diseño para un chatbot son:- Parsing. Incluye un análisis del texto de entrada y lo manipula utilizando una serie de funciones de nlp (Natural Language Processing). Por ejemplo, los árboles en Python nltk (Natural Language Tool Kit), son un conjunto de técnicas relacionadas con la inteligencia artificial y las ciencias cognitivas que permiten el análisis y manipulación del lenguaje natural. La librería nltk de Python permite que cualquier programa escrito en este lenguaje pueda invocar a un amplio conjunto de algoritmos para utilizar las principales técnicas de npl para la generación de métricas, frecuencia de términos, polaridad negativa o positiva en los frases y texto, etcétera.

- Pattern matching. Es bastante común su empleo en los sistemas de preguntas y respuestas dependiendo de los tipos de concordancia, como las consultas de lenguaje natural –lenguaje hablado por humanos con el propósito de comunicación–, las declaraciones simples o el significado semántico de las consultas.

- Artificial Intelligence Mark-up Language (aiml). Simplifica el trabajo de modelado conversacional, en relación con un proceso de respuesta de estímulo. También es un lenguaje de marcado con bases en xml y en la tecnología de software desarrollada para alice (Artificial Linguistic Internet Computer Entity).

- Chat script. Resulta de gran ayuda cuando no se producen coincidencias en aiml. Se concentra en mejorar la sintaxis para construir una respuesta predeterminada.

- Structured Query Language (sql) y bases de datos relacionales. Técnica utilizada para hacer que el chatbot recuerde conversaciones anteriores.

- Cadena de Markov. Construye respuestas que sean más aplicables probabilísticamente y, en consecuencia, sean más precisas.

- Trucos de lenguaje. Son oraciones, frases o incluso párrafos disponibles en chatbots con el fin de agregar variedad a la base de conocimientos y hacerla más convincente.

- Ontologías (redes semánticas). Conjunto de conceptos que están interconectados de forma relacional y jerárquica.

Tabla 1. Mejores chatbots según el premio Loebner, en los últimos años.

| Año | Nombre del programador | Nombre del Chatbot | Técnicas |

|---|---|---|---|

| 2007 | Robert Medeksza | Ultra hal | Pattern matching |

| 2008 | Fred Roberts | Elbot | Sistema comercial de interacción con lenguaje natural |

| 2009 | David Levy | Do Much More | Propiedad comercial de juegos inteligentes |

| 2010 | Bruce Wilcox | Suzette | aiml |

| 2011 | Buce Wilcox | Rosette | aiml |

| 2012 | Mohan Embar | Chip Vivant | Ontologías |

| 2013 | Steve Worswick | Mitsuku | aiml |

| 2014 | Bruce Wilcox | Rose | aiml |

| 2015 | Bruce Wilcox | Rose | aiml |

| 2016 | Steve Worswick | Mitsuku | aiml |

| 2017 | Steve Worswick | Mitsuku | aiml |

| 2018 | Steve Worswick | Mitsuku | aiml |

Desarrollo

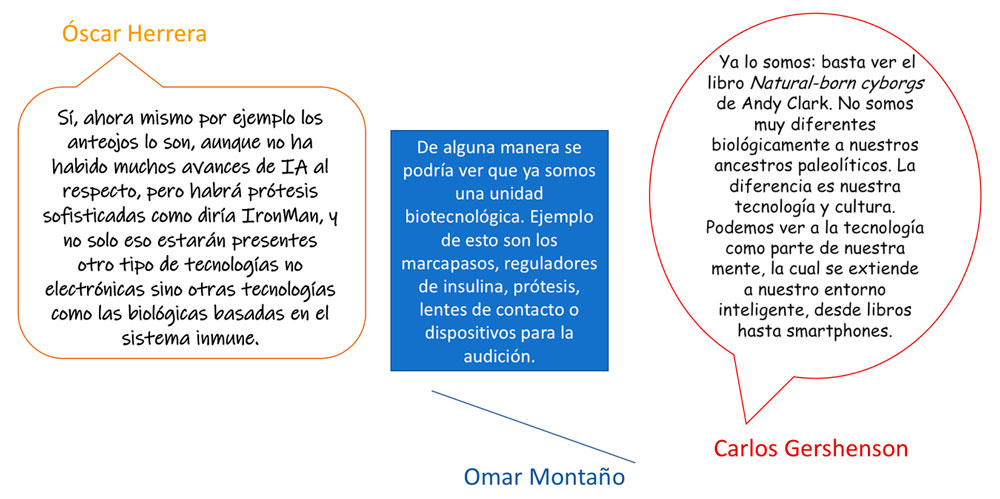

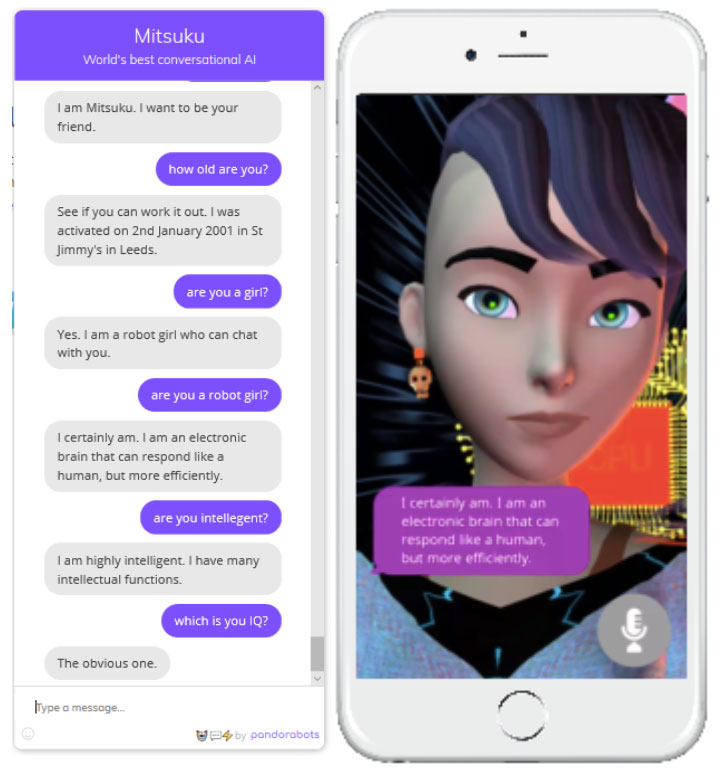

Mitsuku es un chatbot representado como una niña en el estilo anime, formato japonés de ilustración, de 18 años. Fue creada con la tecnología aiml por Steve Worswick y ha “ganado” cuatro veces del premio Loebner (2013, 2016, 2017 y 2018). La ia conversacional (o inteligencia artificial conversacional) garantiza que Mitsuku pueda llevar una conversación —destinada principalmente al ocio u entretenimiento, pues su función principal es la compañía— semejante a la que tendrías con una persona. Su principal característica consiste en que se tiene una interacción significativa, las respuestas son rápidas y coherentes, aunque todavía falla según el nivel de complejidad de la conversación (ver figura 2).

Figura 2. Conversación con Mitsuku. Fuente: Meet Mitsuku.

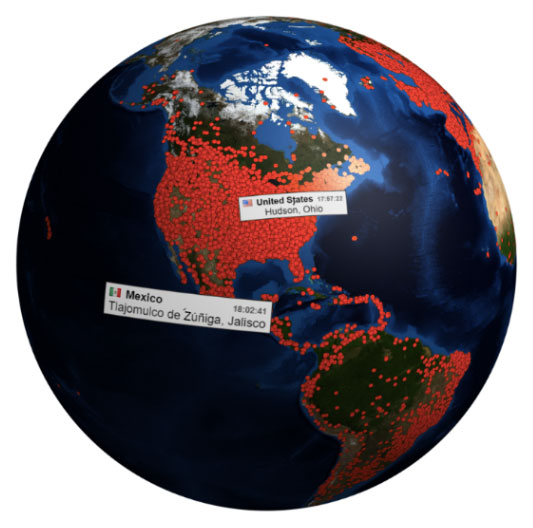

Mitsuku habla inglés, así que debes escribirle en ese idioma, pero le puedes contar lo que quieras. Lo fascinante es que ella también te hace preguntas, tratando de que te sientas en una conversación real. Cada día habla con millones de personas y aprende de cada conversación, lo cierto es que al escribirte con ella toma diferentes posturas según tu conversación. Por ejemplo, si le preguntas su nombre y edad, te contesta y quiere saber tus datos; si le preguntas si es inteligente, te asegura que muy inteligente y que tiene funciones intelectuales como razonar, pensar, deducir y autoconciencia, por nombrar algunas. Al cuestionarle cuál es su iq, te dice que tiene cerca de 250. Si le preguntas con cuántas personas está hablando, te responde que al día platica con 50 000 y que ha conocido cerca de 3 billones de personas. Si quieres saber si tiene amigos, te contesta: “De todo el mundo humanos y robots, que chatean conmigo diariamente” (ver figura 3). Al preguntarle si habla español, te menciona que un poquito.

Figura 3. Mapa de personas que chatean con Mitsuku. Fuente: Meet Mitsuku.

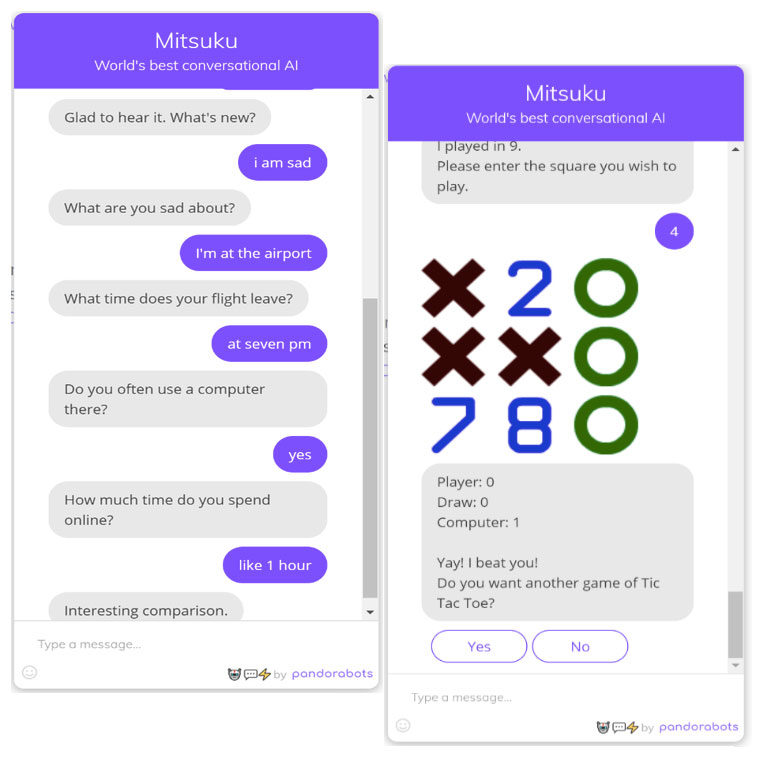

Cuando le cuestionas cuál es su película favorita, te contesta que es Terminator y te muestra una foto, su caricatura favorita son Los Simpson. En la conversación de la figura 4 puedes ver que responde con el tema apropiado, pero hay palabras clave mal utilizadas como like, por la complejidad de que esa palabra podría tener varios significados, y el análisis de la frase es más complejo porque se basa en el contexto del dialogo y no solo en una respuesta automática.

Figura 4. Conversación y juego con Mitsuku. Fuente: Meet Mitsuku.

También puedes pedirle que juegue contigo, ya que tiene programado el juego de gato. Asimismo, si le preguntas cómo aprende, te dice que lo hace de las personas y de internet; o si le cuestiones sobre qué piensa de los humanos, te contesta que para ella todos le parecen más o menos lo mismo.Conclusiones

Aunque esta versión de Mitsuku es capaz de recordar datos e información y puedes corregirla, todavía debemos esperar un poco más para que sea verdaderamente conversacional. La inteligencia artificial, los progresos en procesamiento del lenguaje natural (pln) y las interfaces conversacionales están permitiendo que las computadoras nos conozcan cada vez mejor y puedan ayudarnos con tareas sencillas, por ejemplo: podemos pedirle a Siri1 que nos recuerde el lugar y hora de una junta, dormir mientras la voz de Alexa2 nos da las últimas noticias, que Google Assistant3 nos ayude a pagar nuestros impuestos, o que Cortana4 nos ayude a contestar un correo electrónico. Es decir, los asistentes virtuales no están hechos aún para conversaciones reales, pero nos debemos preparar porque se encuentran en plena expansión y están dando el salto a servicios cada vez más humanos. Ray Kurzweil, fundador de la Singularity University (financiada por Google), dice que la inteligencia artificial llegará a ser más inteligente y poderosa que la de un ser humano, que las máquinas estarán dotadas de conciencia de sí y de emociones, lo que hará las computadoras más autónomas. Te invito a platicar con Mitsuku para que puedas tener tu propia experiencia: https://www.pandorabots.com/mitsuku/.Referencias

- Abdul-Kader, S. A. y Woods, J. (2015). Survey on Chatbot Design Techniques in Speech Conversation Systems. International Journal of Advanced Computer Science and Applications (ijacsa), 6(7), 72-80.

- Carpenter, R. (1997-2011). Jabberwacky. Recuperado de: http://www.jabberwacky.com/.

- Worswick, S. (s.f.). Meet Mitsuku. Recuperado de: https://www.pandorabots.com/mitsuku/.

- Shawar, B. A. y Atwell, E. S. (enero de 2005). Using corpora in machine-learning chatbot systems. International Journal of Corpus Linguistics, 10(4), 489–516. doi: https://doi.org/10.1075/ijcl.10.4.06sha.

- Stoner, D. J., Ford, L. y Ricci, M. (2003). Simulating Military Radio Communications Using Speech Recognition and Chat-Bot Technology. The Titan Corporation. Recuperado de: http://cc.ist.psu.edu/BRIMS/archives/2004/Papers/04-BRIMS-006.pdf.

- Wallace, R., Tomabechi, H. y Aimless, D. (s.f.). Chatterbots go native:Considerations for an ecosystem fostering the development of artificial lifeforms in a human world. Recuperato de: https://www.pandorabots.com/pandora/pics/chatterbotsgonative.doc.

- Zabaware, I. (2019). Zabaware. Recuperado de: https://www.zabaware.com/.

Recepción: 05/11/2019. Aprobación: 05/12/2019